가트너 보고서, 2028년 주요 국가 기반 시설 붕괴 예측. CIO는 자율 에이전트에 대한 산업 제어 재고해야. AI 오작동 막을 안전장치 시급.

산업 AI, 빠른 속도만큼 커지는 위험

2026년, 산업 제어 시스템에 AI 도입이 가속화되면서 예상치 못한 위험이 부각되고 있습니다. 가트너는 2028년까지 AI 문제로 인해 주요 국가의 핵심 기반 시설이 붕괴될 수 있다고 경고하며, CIO들에게 자율 에이전트에 대한 산업 제어를 재고할 것을 촉구했습니다. 특히 AI 시스템의 오작동으로 인한 미묘한 변화를 감지하지 못해 발생하는 사고 가능성을 우려하고 있습니다.

CPS 시대, 간과할 수 없는 AI 위험

가트너는 사이버 물리 시스템(CPS)이라는 용어를 통해 운영 기술(OT), 산업 제어 시스템(ICS), 산업 자동화 및 제어 시스템(IACS), 산업 사물 인터넷(IIoT), 로봇, 드론, Industry 4.0 등을 포괄하는 기술을 정의했습니다. 왐 보스터 가트너 VP 분석가는 “다음 인프라 실패는 해커나 자연 재해가 아닌, 선의의 엔지니어, 결함 있는 업데이트 스크립트 또는 잘못 배치된 소수점으로 인해 발생할 수 있다”고 지적했습니다. 따라서 AI 오작동으로 인한 의도치 않은 중단을 방지하기 위해 권한 있는 운영자만 접근할 수 있는 안전 장치 또는 재정의 모드가 필수적입니다.

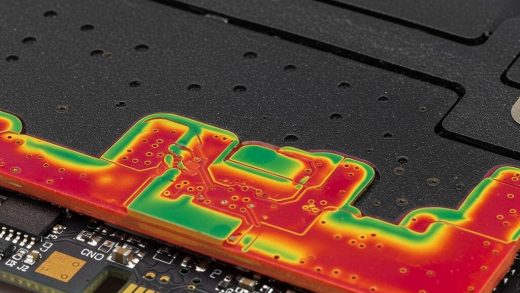

모델 드리프트 감지 취약점

고스트라인 전략의 설립자 맷 모리스는 산업 AI 제어의 문제점 중 하나로 모델 드리프트 감지의 취약성을 지적했습니다. 시스템이 압력 밸브를 모니터링하도록 설정되었을 때, 정상 수치가 시간이 지남에 따라 서서히 변동하는 경우, 시스템은 이러한 변화를 단순한 배경 소음으로 간주할 수 있습니다. 경험 많은 관리자라면 잠재적인 문제를 감지할 수 있지만, AI는 그렇지 못할 수 있다는 것입니다.

맹목적인 AI 도입 경계

LexisNexis Risk Solutions Group의 CISO인 플라비오 빌라누스트레는 AI가 너무 빠르게 제어권을 가져가는 것에 대한 우려를 표명했습니다. 환경 시스템이나 발전기를 AI가 제어할 때, 복잡성과 비결정적 행동의 조합은 심각한 결과를 초래할 수 있습니다. 기업 이사회와 CEO들은 AI가 생산성 향상과 비용 절감을 가져다줄 것이라고 기대하지만, 그들이 감수하는 위험은 잠재적인 이익보다 훨씬 클 수 있다고 경고합니다.

취약한 자동화 계층, AI 위험 증폭

사이버 보안 컨설턴트 브라이언 레빈은 핵심 기반 시설이 수십 년에 걸쳐 덧대어진 취약한 자동화 계층 위에서 운영된다는 점을 지적하며, 그 위에 자율 AI 에이전트를 추가하는 것은 허리케인 속의 젠가 타워를 쌓는 것과 같다고 비유했습니다. 그는 AI 안전 및 보안에 대한 신뢰할 수 있는 프레임워크를 채택하고 성숙도를 측정하는 것이 중요하다고 강조합니다.

AI 거버넌스 및 운영 통제의 중요성

Info-Tech Research Group의 사이버 보안 자문위원인 밥 윌슨은 AI가 기업 전략에 빠르게 통합되면서 거버넌스 프레임워크가 따라가지 못하는 상황을 우려했습니다. 그는 AI를 잠재적인 내부자 위협으로 간주하고, AI 설정 및 구성 변경 권한, 변경 테스트 방법, 롤아웃 관리 방식, 롤백 속도 등에 대한 엄격한 거버넌스를 구축해야 한다고 강조했습니다.

AI 관리 방식의 전환

Greyhound Research의 수석 분석가인 산치트 비르 고기아는 AI를 단순한 분석 도구가 아닌 제어 시스템의 일부로 간주해야 한다고 주장했습니다. 그는 AI 시스템이 물리적 프로세스에 간접적으로라도 영향을 미치는 순간, 안전 엔지니어링의 책임을 물어야 한다고 덧붙였습니다. 또한 AI 기반 운영 구성 요소에 대한 최악의 행동 시나리오를 명확하게 정의하고, 팀이 이러한 질문에 명확하게 답할 수 없을 경우 거버넌스 성숙도가 불완전하다고 지적했습니다.